Diferència entre revisions de la pàgina «Grup 5 - 6. Storage pool. Configuració de volum compartit d’alta disponibilitat amb Redhat Ceph RBD, GlusterFS, o altres.»

| Línia 90: | Línia 90: | ||

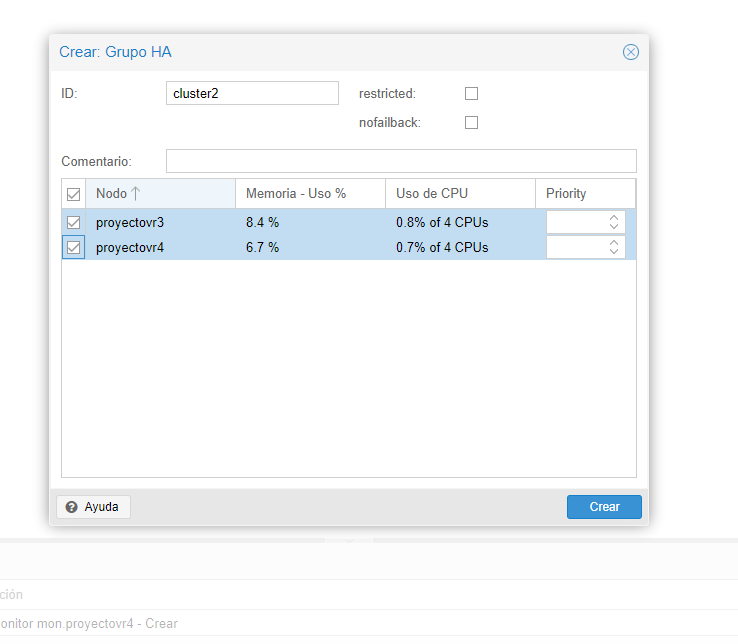

Primero comprobamos el estado actual del cluster con el comando '''pvecm status''', vemos que aparecen los dos nodos que tenemos. | Primero comprobamos el estado actual del cluster con el comando '''pvecm status''', vemos que aparecen los dos nodos que tenemos. | ||

| + | [[File:gp5_rasp_1.png|node_status|border|800px]] | ||

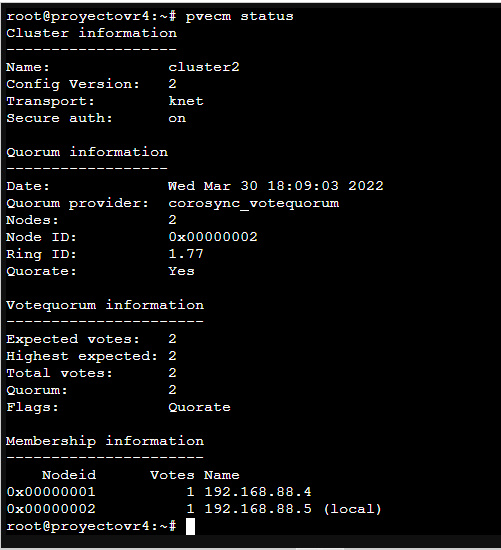

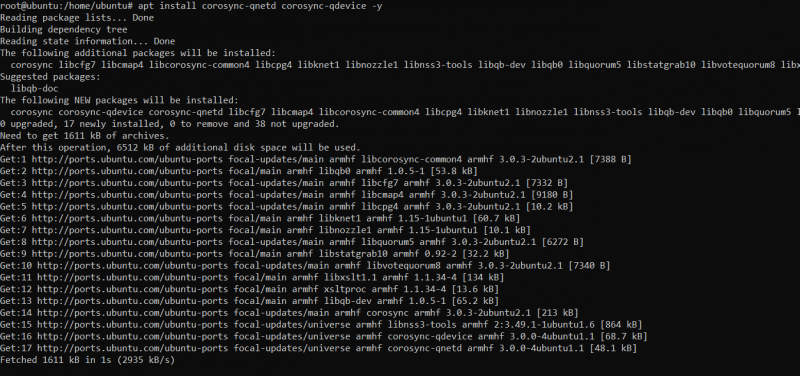

Después instalamos las dependencias '''corosync-qdevice''' en ambos nodos del cluster. | Después instalamos las dependencias '''corosync-qdevice''' en ambos nodos del cluster. | ||

| + | [[File:gp5_rasp_2.png|node_status|border|800px]] | ||

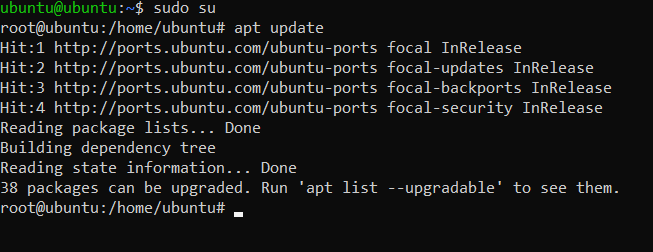

En la raspberry, con permisos root instalamos las dependencias '''corosync-qdevice''' y '''corosync-qnetd'''. | En la raspberry, con permisos root instalamos las dependencias '''corosync-qdevice''' y '''corosync-qnetd'''. | ||

| + | [[File:gp5_rasp_3.png|node_status|border|800px]] | ||

| + | |||

| + | [[File:gp5_rasp_4.png|node_status|border|800px]] | ||

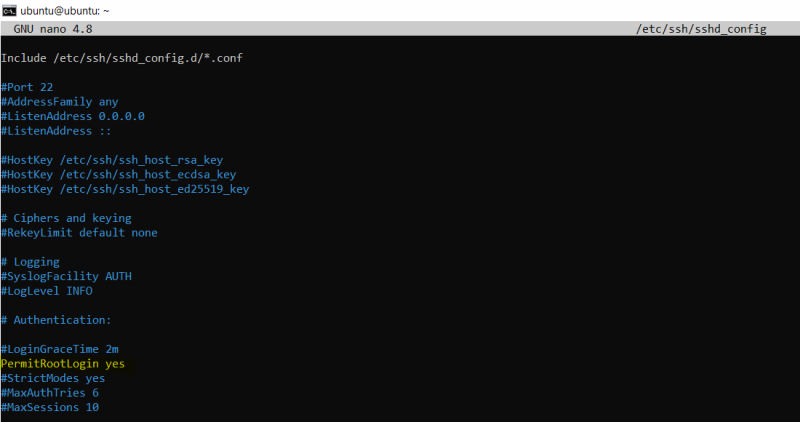

En la raspberry, es necesario tener el servicio ssh activo, y permitiendo el root login en el fichero '''/etc/ssh/sshd_config''' | En la raspberry, es necesario tener el servicio ssh activo, y permitiendo el root login en el fichero '''/etc/ssh/sshd_config''' | ||

| + | [[File:gp5_rasp_6.png|node_status|border|800px]] | ||

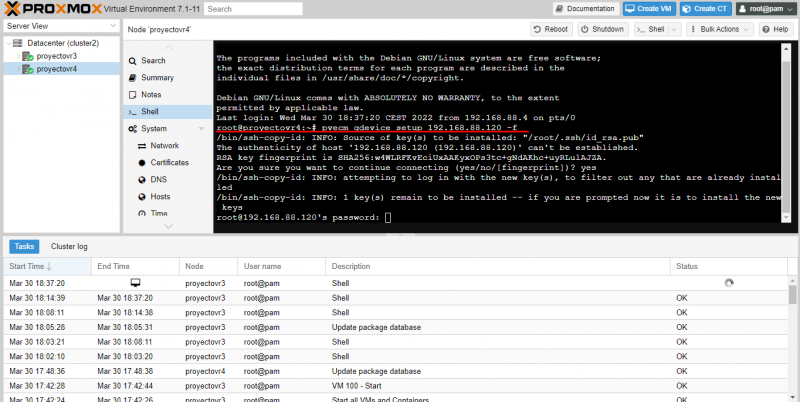

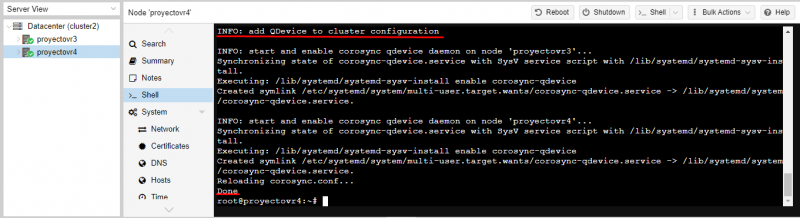

En el nodo master, ejecutamos el comando '''pvecm qdevice setup 192.168.88.120 -f''' con la IP de la raspberry e introducimos la contraseña de root | En el nodo master, ejecutamos el comando '''pvecm qdevice setup 192.168.88.120 -f''' con la IP de la raspberry e introducimos la contraseña de root | ||

| + | [[File:gp5_rasp_5.png|node_status|border|800px]] | ||

| + | |||

| + | [[File:gp5_rasp_7_2.png|node_status|border|800px]] | ||

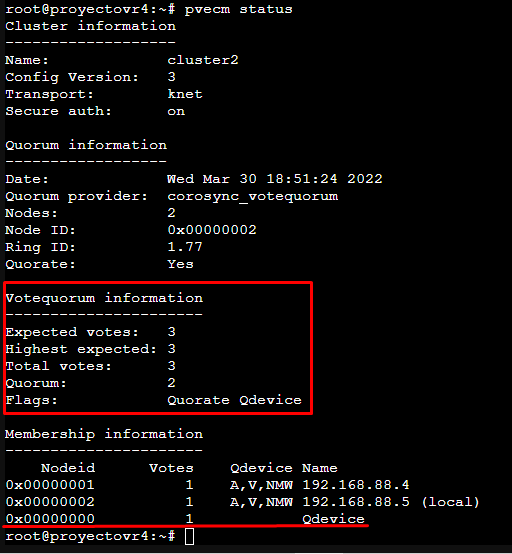

Una vez hecho esto ya está añadido el nodo qdevice, comprobamos con '''pvecm status''' que se ha añadido. | Una vez hecho esto ya está añadido el nodo qdevice, comprobamos con '''pvecm status''' que se ha añadido. | ||

| + | |||

| + | [[File:gp5_rasp_9.png|node_status|border|800px]] | ||

Revisió del 13:56, 31 març 2022

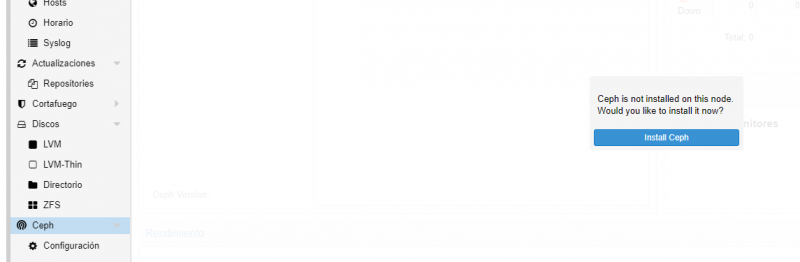

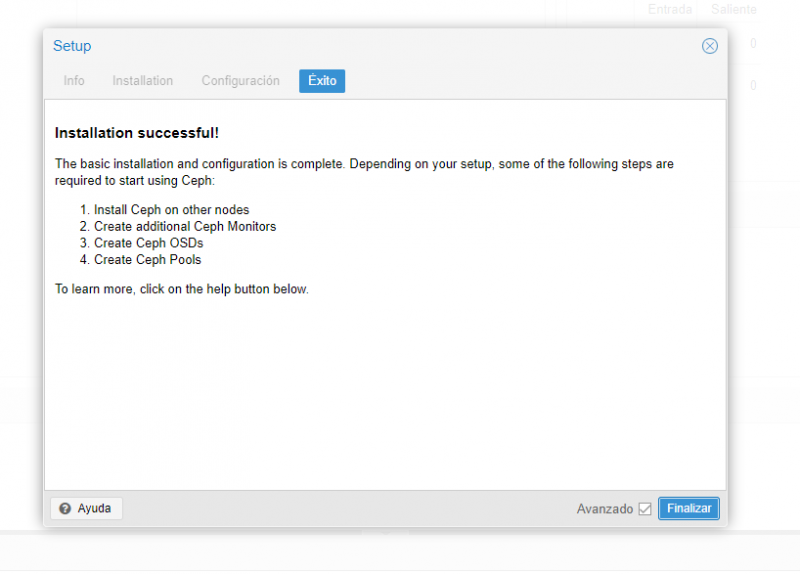

Ahora vamos al apartado del Ceph y empezamos, hacemos click en empezar la instalación y seguimos

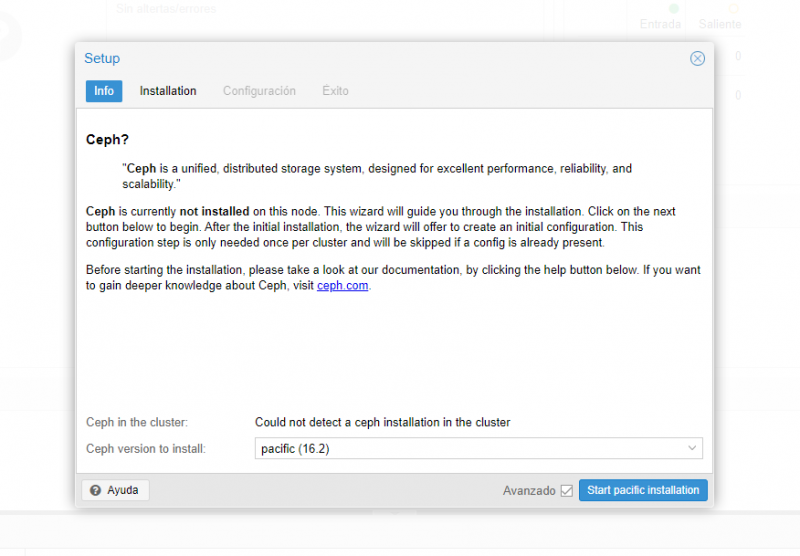

Utilizaremos Pacific

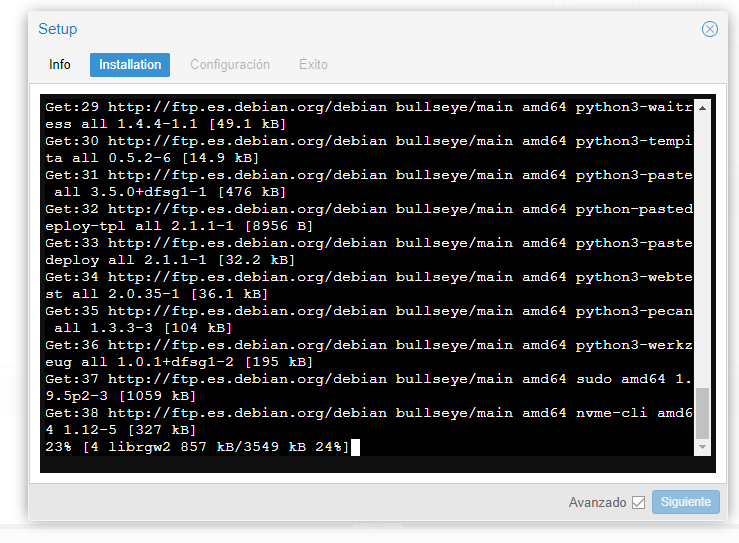

Le damos a Y y enter

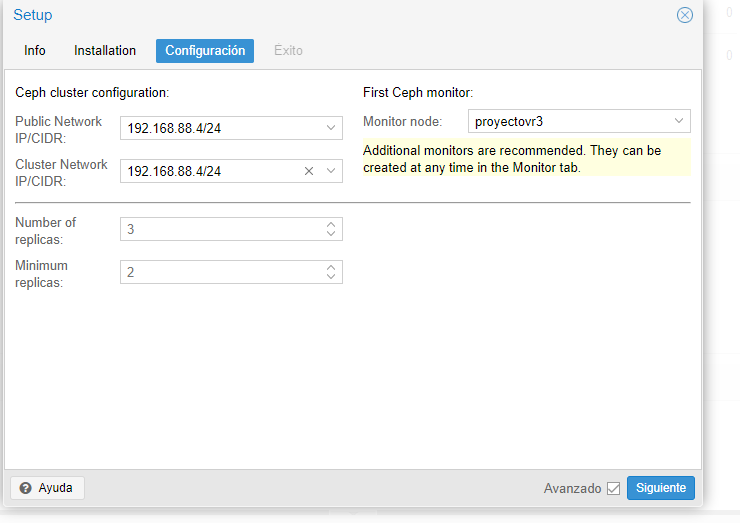

Rellenamos con la IP del servidor y click en siguiente

Finalmente repetimos el mismo proceso para el otro nodo

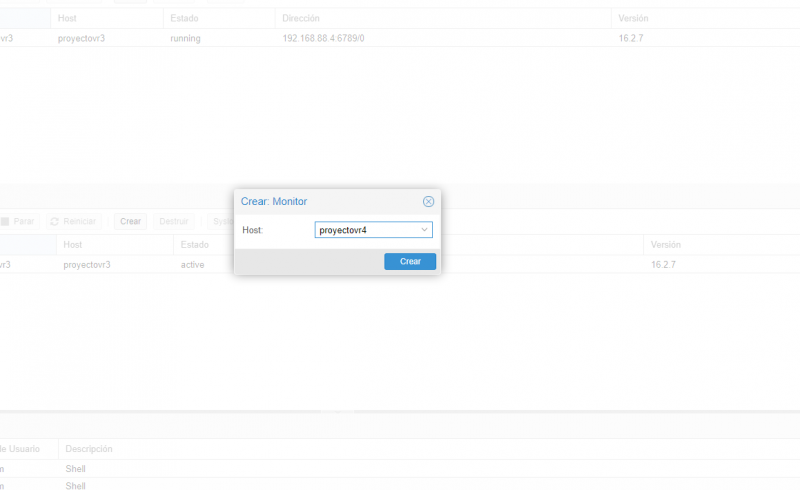

Nos dirigimos a el segundo Cluster y vamos al apartado de Monitor, una vez ahí, hacemos click en Crear

Veremos como se añaden los diferentes nodos

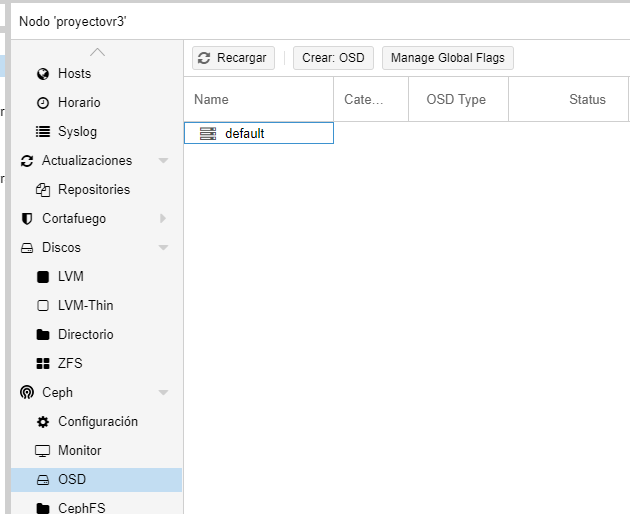

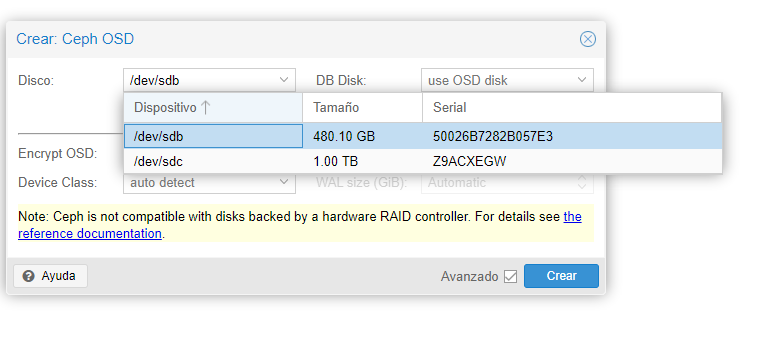

Nos dirigimos a el apartado de Ceph --> OSD --> Crear OSD

Una vez ahí, elegimos el disco que queremos utilizar y hacemos click en crear, en nuestro caso hay que utilizar el disco de 500G

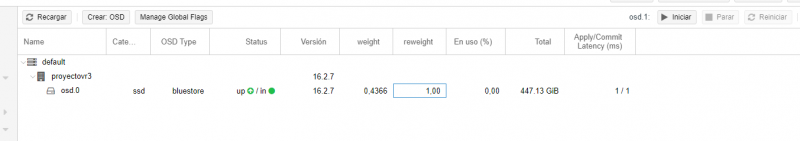

Repetimos el mismo proceso por cada host/disco y finalmente podremos ver como se han añadido todos los discos de los diferentes hosts

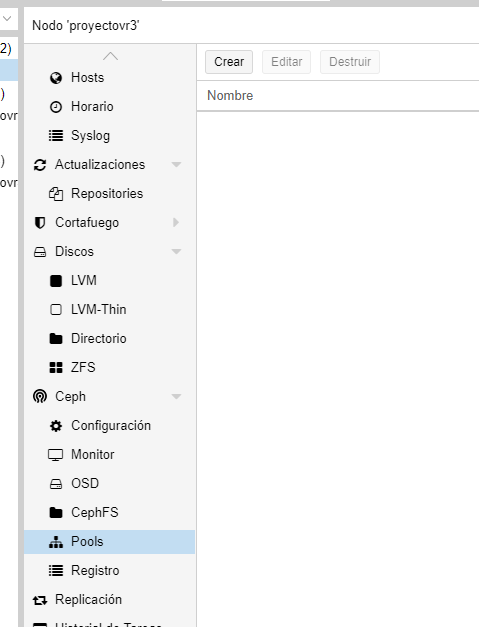

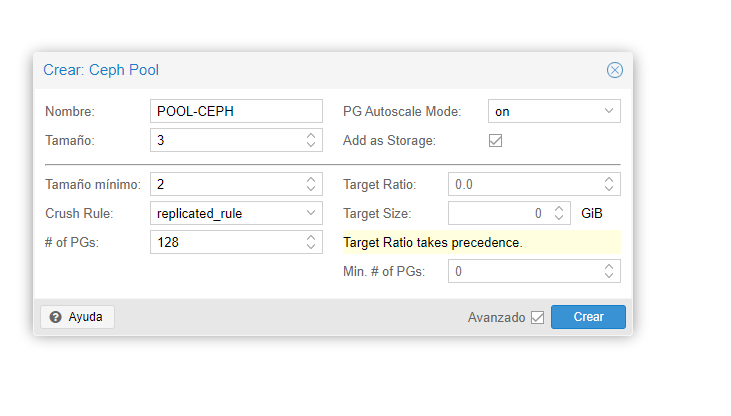

Nos dirigimos al el apartado Ceph --> Pools --> Crear, indicamos la información correspondiente y hacemos click en cerrar

Elegimos el nombre de la Pool, el tamaño etc... y hacemos click en Crear, uan vez creada, la podremos ver en el apartado Pools

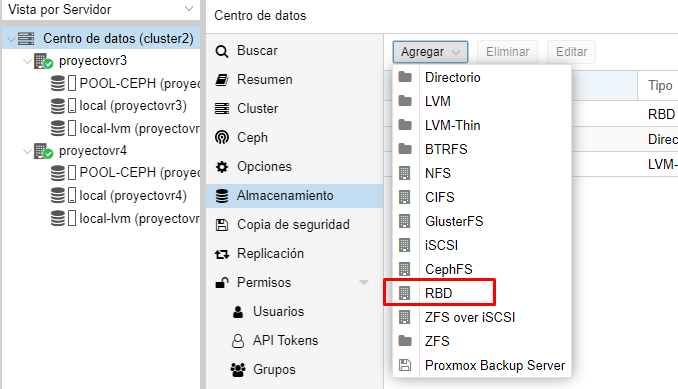

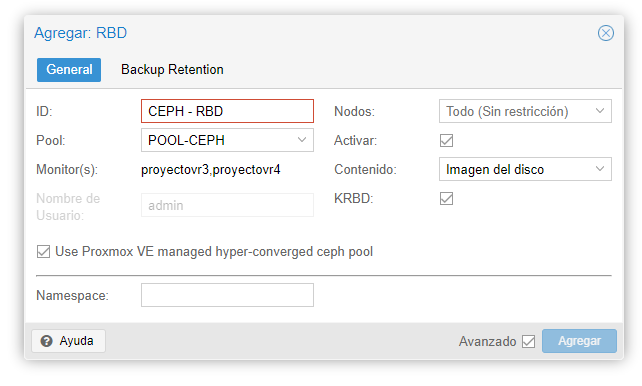

Ahora nos dirigimos a Centro de datos –-> Almacenamiento --> Agregar --> RBD

Aquí tenemos que elegir el contenido que va a almacenar, básicamente hay que darle un nombre, y elegir la pool

Ahora podemos ver el almacenamiento en los hosts

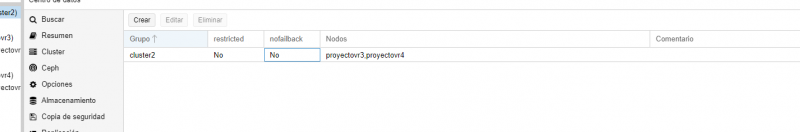

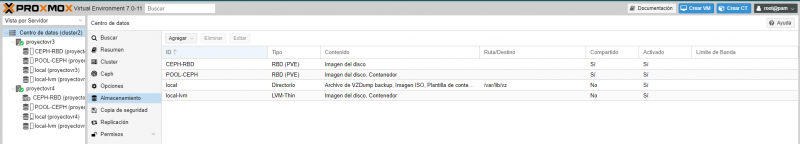

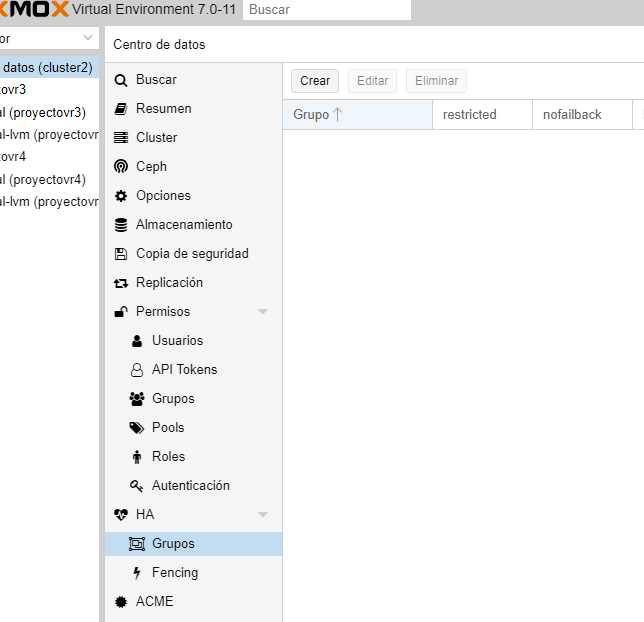

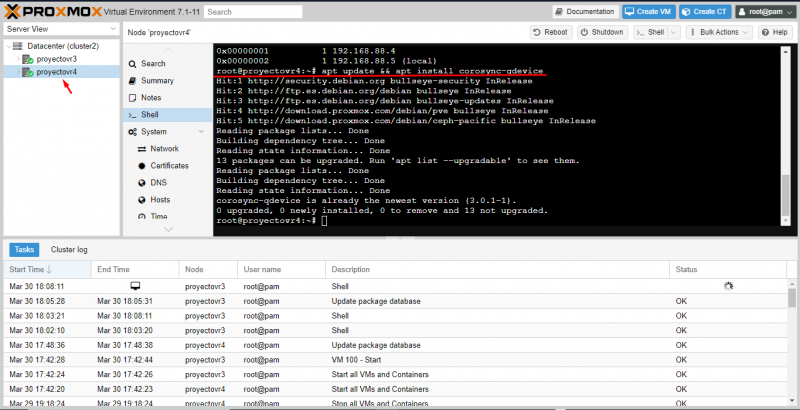

Vamos a crear los Grupos para realizar la Alta disponibilidad

Para ello nos dirigimos a Cluster --> HA --> Grupos --> Crear

Ahora, tenemos que elegir quien queremos que forme parte del grupo y hacemos click en Crear

Ahora solo queda añadir una ISO y crear una maquina para realizar un test y comprobar el correcto funcionamiento, pero antes de eso, hay que hacer una pequeña modificación en el archivo de configuración del Ceph

Abrimos un terminal y nos dirigimos a /etc/ceph/ceph.conf y en la parte de osd_pool_default_min_size ponemos como valor 1, esta va a hacer que el numero mínimo de pools necesarias sean 1 y en osd_pool_default_size, ponemos como valor 2, esto indica el numero de pools que tenemos, en nuestro caso 2

Primero comprobamos el estado actual del cluster con el comando pvecm status, vemos que aparecen los dos nodos que tenemos.

Después instalamos las dependencias corosync-qdevice en ambos nodos del cluster.

En la raspberry, con permisos root instalamos las dependencias corosync-qdevice y corosync-qnetd.

En la raspberry, es necesario tener el servicio ssh activo, y permitiendo el root login en el fichero /etc/ssh/sshd_config

En el nodo master, ejecutamos el comando pvecm qdevice setup 192.168.88.120 -f con la IP de la raspberry e introducimos la contraseña de root

Una vez hecho esto ya está añadido el nodo qdevice, comprobamos con pvecm status que se ha añadido.